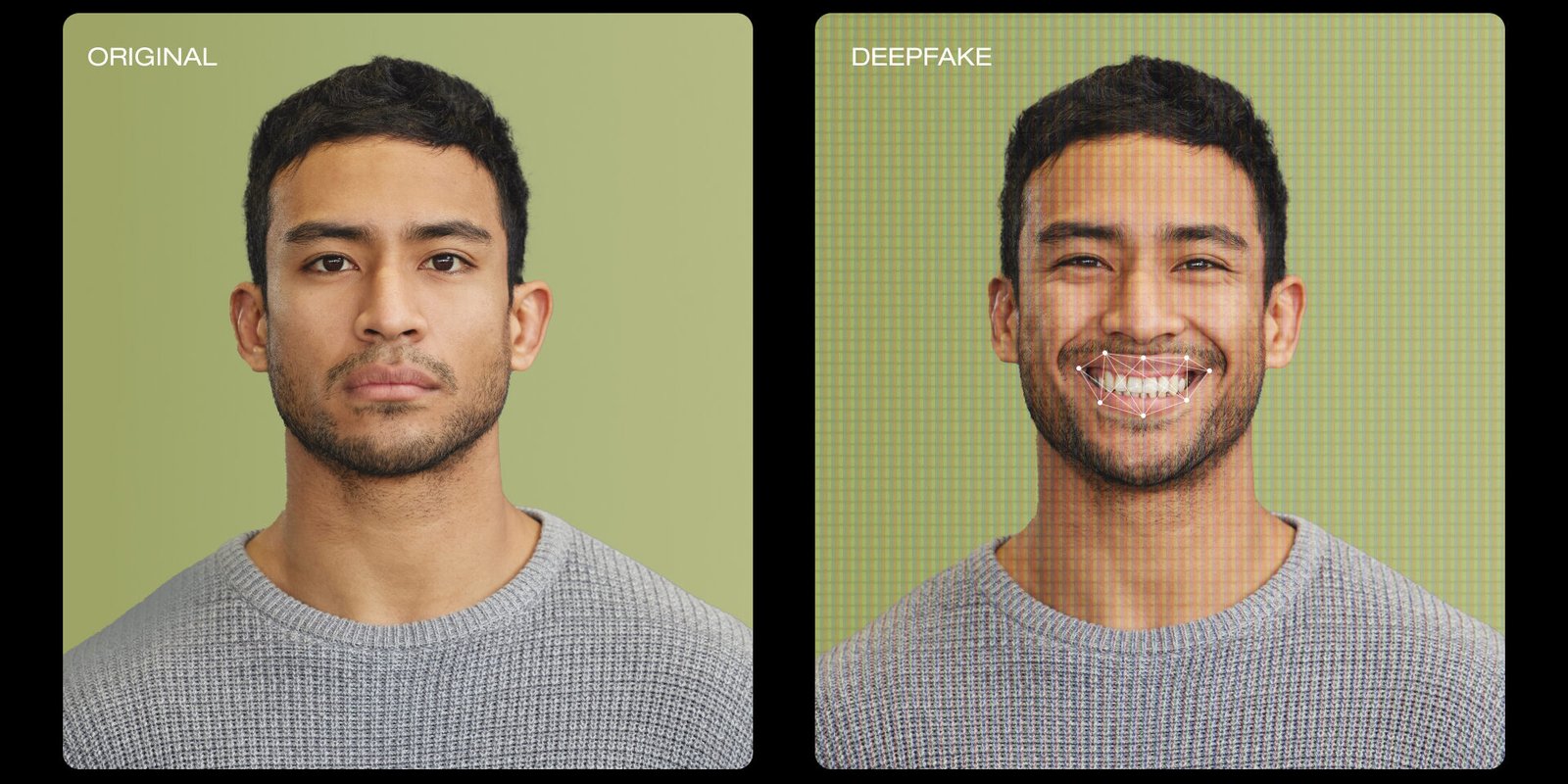

O volume de vídeos e imagens falsas geradas por inteligência artificial cresceu de forma exponencial nos últimos dois anos e já começa a gerar impactos concretos na segurança digital, na economia e na vida das pessoas. Projeções da empresa de cibersegurança DeepStrike indicam que a produção de deepfakes saltou de cerca de 500 mil conteúdos em 2023 para aproximadamente 8 milhões em 2025, com expectativa de crescimento ainda mais acelerado em 2026, incluindo materiais capazes de interagir com pessoas em tempo real.

LEIA TAMBÉM: Sabesp passa a usar inteligência artificial para detectar vazamentos de água em vias urbanas

O avanço da tecnologia vem sendo explorado para fraudes financeiras sofisticadas, manipulação política, chantagens e para a criação de deepfakes sexuais (imagens e vídeos íntimos falsos produzidos a partir de fotos reais), sem consentimento das vítimas. Para o advogado Carlos Eduardo Holz, especialista em Direito Digital, o problema extrapola a tecnologia e entra no campo jurídico e social. Segundo ele, embora existam leis aplicáveis, elas não acompanham a velocidade das mudanças. “Estamos diante de uma tecnologia que possibilita fraudes, chantagens e a criação de conteúdo sexual envolvendo pessoas reais sem consentimento, o que fere direitos fundamentais”, afirma.

Entre os usos mais graves da inteligência artificial está justamente a produção de deepfakes sexuais. Em outubro de 2025, o pesquisador de cibersegurança Jeremiah Fowler identificou a exposição de mais de 1 milhão de deepfakes pornográficos, incluindo conteúdos envolvendo adultos e crianças, armazenados de forma insegura na rede internacional MagicEdit. O episódio evidenciou a produção em massa e a circulação descontrolada desse tipo de material.

No Brasil, os efeitos já aparecem em dados oficiais. Informações da SaferNet Brasil apontam que quase 50 mil denúncias de abuso infantil online foram registradas em um único ano, muitas delas associadas ao uso de inteligência artificial para manipulação de imagens. Paralelamente, uma pesquisa da empresa internacional Sumsub mostra que golpes envolvendo deepfakes cresceram 822% no país em apenas um ano, colocando o Brasil entre os mercados mais afetados por esse tipo de crime.

Segundo o advogado, parte desse avanço está relacionada ao funcionamento dos algoritmos das plataformas digitais, que acabam impulsionando conteúdos de alto engajamento. “Qualquer reação, mesmo crítica ou de dúvida, alimenta o sistema e amplia o alcance desse tipo de material”, explica. As fraudes incluem clonagem de voz para autorizar transferências bancárias, vídeos falsos de executivos ou familiares e o uso de imagens manipuladas para extorsão e chantagem.

Do ponto de vista legal, o advogado destaca que o Brasil possui instrumentos para responsabilização, como o Código Penal, o Código Civil e o Marco Civil da Internet, mas considera o arcabouço insuficiente diante da sofisticação dos deepfakes. No Congresso Nacional, tramita o Projeto de Lei nº 2.338/2023, que propõe regras para o desenvolvimento e uso ético da inteligência artificial. Além disso, decisões recentes do Supremo Tribunal Federal reforçaram que plataformas digitais podem ser responsabilizadas quando se mantêm omissas diante da circulação de conteúdos ilícitos.

Enquanto a legislação não evolui, a principal barreira contra os deepfakes ainda é o comportamento dos usuários. A recomendação é verificar a origem dos conteúdos, desconfiar de materiais sensacionalistas, evitar compartilhamentos impulsivos e denunciar conteúdos enganosos. “Fomos inseridos nas tecnologias sem educação digital. Antes de compartilhar, é preciso parar e refletir, porque quem cria ou dissemina conteúdo falso pode enfrentar consequências jurídicas e até perder sua fonte de renda”, alerta o especialista.